Sản Phẩm Bán Chạy

Bạn đang “nuôi” ChatGPT bằng dữ liệu cá nhân như thế nào?

Mỗi cuộc trò chuyện đều góp phần làm AI hiểu bạn hơn. Nhưng điều đó cũng đồng nghĩa với việc dữ liệu cá nhân ngày càng nhiều.

Nội dung

- 1. Bạn đang “nuôi” AI bằng dữ liệu cá nhân của chính mình?

- 2. Trách nhiệm quyền riêng tư trên ChatGPT là của ai?

- 2.1. Xác thực đa yếu tố (MFA)

- 2.2. Việc mặc định dùng dữ liệu người dùng để huấn luyện AI

- 2.3. “Trí nhớ” của AI: tiện lợi hay rủi ro tiềm ẩn?

- 2.4. Temporary Chat: giải pháp tốt nhưng chưa được phổ biến đúng mức

ChatGPT là một trong những sản phẩm số mang tính bước ngoặt lớn nhất hiện nay. Không phải vì nó “thông minh như con người” mà vì cách nó len lỏi vào đời sống cá nhân và công việc hằng ngày của hàng triệu người với tốc độ chưa từng có. Chúng ta dùng ChatGPT để viết email, lên ý tưởng thiết kế, sửa code, giải thích bệnh lý, chuẩn bị bài thuyết trình, thậm chí để trút bầu tâm sự. Ranh giới giữa một công cụ hỗ trợ và một “đối tượng để chia sẻ” ngày càng mờ nhạt. Và chính tại điểm mờ nhạt đó, vấn đề quyền riêng tư bắt đầu trở nên đáng báo động. Bài viết này không nhằm công kích ChatGPT hay OpenAI. Ngược lại, nó nhìn nhận ChatGPT như một công cụ mạnh mẽ, hữu ích, nhưng cần được sử dụng đúng cách và cần những thay đổi về mặt thiết kế tính năng để bảo vệ người dùng tốt hơn.

Nâng Cấp Tài Khoản ChatGPT Chính Chủ Giá Rẻ

1. Bạn đang “nuôi” AI bằng dữ liệu cá nhân của chính mình?

Kể từ khi bùng nổ vào cuối năm 2022, ChatGPT nhanh chóng trở thành ứng dụng “phải có” trên cả máy tính lẫn điện thoại. Tốc độ lan tỏa của nó thậm chí còn nhanh hơn mạng xã hội trong giai đoạn đầu, bởi ChatGPT không chỉ giải trí, mà trực tiếp giúp người dùng giải quyết vấn đề.

Khác với Google hay Facebook, ChatGPT khuyến khích người dùng viết, kể, mô tả và chia sẻ. Càng cung cấp nhiều ngữ cảnh, câu trả lời càng tốt. Chính điều này vô tình tạo ra một thói quen nguy hiểm: chia sẻ quá mức.

Nhiều người không nhận ra rằng mỗi đoạn chat không chỉ là một câu hỏi, câu trả lời, mà là một mảnh ghép trong hồ sơ hành vi số của họ. Từ cách diễn đạt, chủ đề quan tâm, công việc, tâm trạng, cho đến thông tin cá nhân được tiết lộ trực tiếp hoặc gián tiếp, tất cả đều có thể trở thành dữ liệu huấn luyện cho AI nếu người dùng không chủ động kiểm soát.

Các chuyên gia bảo mật đều đồng ý rằng, trước khi bàn đến cài đặt kỹ thuật, nguyên tắc vàng đầu tiên khi sử dụng AI là: không chia sẻ những gì bạn không muốn bị lưu trữ, phân tích hoặc rò rỉ trong một kịch bản xấu nhất.

ChatGPT không phải là bạn thân. Nó không có nghĩa vụ giữ bí mật như bác sĩ hay luật sư. Việc nhập họ tên đầy đủ, số CCCD, tài khoản ngân hàng, hồ sơ y tế, hợp đồng nội bộ hay dữ liệu khách hàng vào khung chat là một rủi ro nghiêm trọng, kể cả khi bạn tin rằng hệ thống “an toàn”.

2. Trách nhiệm quyền riêng tư trên ChatGPT là của ai?

Một câu hỏi thường được đặt ra là: bảo vệ dữ liệu trên ChatGPT là trách nhiệm của OpenAI hay của người dùng?

Câu trả lời thực tế là: cả hai.

OpenAI có trách nhiệm thiết kế sản phẩm minh bạch, dễ hiểu, đặt quyền riêng tư ở vị trí trung tâm thay vì giấu trong các lớp cài đặt sâu. Trong khi đó, người dùng cần có hiểu biết tối thiểu và chủ động điều chỉnh hành vi sử dụng.

Vấn đề nằm ở chỗ, rất nhiều tính năng quan trọng liên quan đến quyền riêng tư trên ChatGPT hiện nay không được bật mặc định, hoặc không được giải thích đủ rõ ràng. Điều này khiến người dùng phổ thông dễ dàng bỏ qua.

Dưới đây là bốn thiết lập mà bất kỳ ai đang sử dụng ChatGPT thường xuyên cũng nên thực hiện ngay, đồng thời cũng là những điểm cho thấy ChatGPT vẫn còn nhiều dư địa để cải thiện về mặt thiết kế trải nghiệm người dùng (UX) nhằm bảo vệ dữ liệu cá nhân tốt hơn.

2.1. Xác thực đa yếu tố (MFA)

Rất nhiều người cho rằng tài khoản ChatGPT “không có gì quan trọng”. Đây là một suy nghĩ sai lầm. Với người dùng lâu năm, tài khoản ChatGPT có thể chứa hàng trăm, thậm chí hàng nghìn đoạn hội thoại, phản ánh rất rõ công việc, mối quan tâm và tư duy cá nhân.

Nếu tài khoản này bị chiếm quyền truy cập, kẻ xấu không chỉ đọc được lịch sử chat, mà còn có thể lợi dụng nó để tiếp tục khai thác thông tin hoặc mạo danh người dùng.

ChatGPT hiện đã hỗ trợ xác thực đa yếu tố (Multi-factor authentication: MFA), nhưng vấn đề là tính năng này không được nhấn mạnh đủ mạnh trong quá trình onboarding. Nhiều người dùng hoàn toàn không biết rằng họ có thể bật MFA.

Khi MFA được kích hoạt, mỗi lần đăng nhập từ thiết bị mới, hệ thống sẽ yêu cầu một mã xác thực từ ứng dụng thứ ba. Điều này khiến việc lộ mật khẩu đơn thuần không còn đủ để xâm nhập tài khoản.

2.2. Việc mặc định dùng dữ liệu người dùng để huấn luyện AI

Đây là thiết lập quan trọng nhất liên quan đến quyền riêng tư, nhưng cũng là thiết lập gây tranh cãi nhất.

Theo mặc định, các cuộc hội thoại của người dùng có thể được OpenAI sử dụng để cải thiện và huấn luyện các mô hình AI trong tương lai. Về mặt nghiên cứu, điều này là hợp lý. Nhưng về mặt người dùng, đây là một quyết định mang tính “opt-out” thay vì “opt-in”.

Nói cách khác, nếu bạn không chủ động tắt, dữ liệu của bạn có thể được dùng.

Rất nhiều người không hề biết điều này. Họ sử dụng ChatGPT như một cuốn sổ tay cá nhân, một trợ lý công việc, mà không nhận ra rằng nội dung chat có thể không chỉ nằm trong phạm vi cá nhân.

ChatGPT cho phép người dùng tắt tính năng này trong phần Data Controls với tùy chọn “Improve the model for everyone”. Khi tắt, nội dung chat của bạn sẽ không được dùng để huấn luyện mô hình chung.

Tuy nhiên, từ góc độ thiết kế UX, việc đặt một tùy chọn quan trọng như vậy trong cài đặt sâu là chưa đủ. Với một sản phẩm xử lý dữ liệu nhạy cảm, lý tưởng nhất là người dùng được hỏi rõ ràng ngay từ đầu: bạn có đồng ý chia sẻ dữ liệu để huấn luyện AI hay không?

Điều đáng chú ý là với các tài khoản doanh nghiệp (Enterprise), tính năng này thường được tắt mặc định. Điều đó cho thấy OpenAI hoàn toàn nhận thức được rủi ro về dữ liệu, nhưng lại áp dụng tiêu chuẩn khác nhau giữa người dùng cá nhân và doanh nghiệp.

2.3. “Trí nhớ” của AI: tiện lợi hay rủi ro tiềm ẩn?

Một trong những tính năng mới và gây nhiều tranh luận nhất của ChatGPT là khả năng “Memory” tức là ghi nhớ những thông tin người dùng đã chia sẻ để phục vụ cho các cuộc trò chuyện sau.

Về mặt trải nghiệm, đây là một bước tiến lớn. ChatGPT có thể nhớ phong cách viết, lĩnh vực làm việc, sở thích hay các dự án đang theo đuổi, từ đó đưa ra câu trả lời phù hợp hơn.

Nhưng từ góc độ quyền riêng tư, đây lại là một con dao hai lưỡi.

Thứ nhất, AI có thể “nhớ sai”. Một thông tin lỗi thời, một giả định không chính xác hoặc một chi tiết nhạy cảm bị ghi nhớ có thể ảnh hưởng đến các lần tương tác sau, thậm chí gây hiểu nhầm nghiêm trọng.

Thứ hai, người dùng thường không ý thức được rằng mình đang tạo ra “ký ức” cho AI. Việc này diễn ra âm thầm và chỉ khi vào phần cài đặt, người dùng mới thấy danh sách những gì ChatGPT đang ghi nhớ.

Tính năng Memory hiện có thể được quản lý trong phần Personalization. Người dùng có thể xem, chỉnh sửa hoặc xóa từng ký ức cụ thể. Đây là một điểm cộng, nhưng vẫn chưa đủ.

Xem thêm : Nâng Cấp Chatgpt Plus

2.4. Temporary Chat: giải pháp tốt nhưng chưa được phổ biến đúng mức

Khi cần hỏi những vấn đề nhạy cảm, nhiều người vẫn vô thức dùng khung chat mặc định. Điều này dẫn đến việc các cuộc hội thoại được lưu lại trong lịch sử và có thể được dùng cho mục đích huấn luyện nếu người dùng chưa tắt thiết lập liên quan.

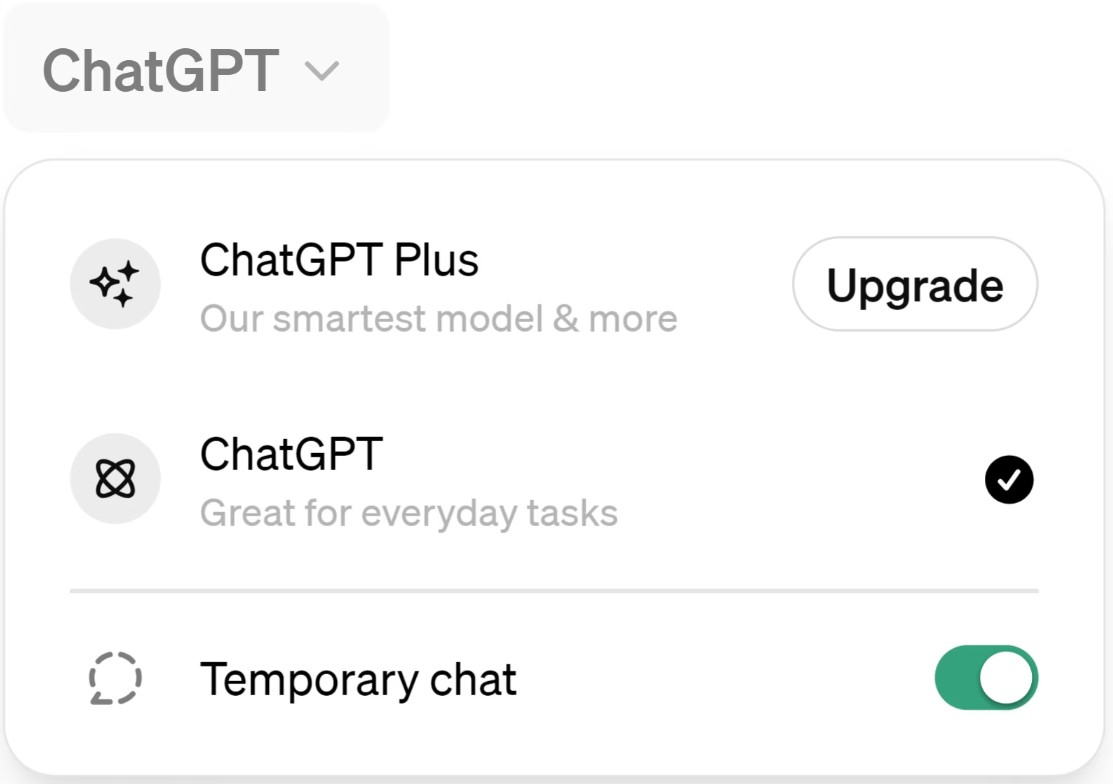

ChatGPT đã cung cấp chế độ Temporary Chat: một dạng chat ẩn danh. Các cuộc trò chuyện trong chế độ này không được lưu vào lịch sử và không được dùng để huấn luyện AI. Đây là một giải pháp rất tốt cho các câu hỏi mang tính riêng tư.

Tuy nhiên, điểm hạn chế là rất ít người biết đến hoặc sử dụng tính năng này thường xuyên. Nó không được đặt ở vị trí nổi bật, cũng không được giải thích rõ ràng khi người dùng bắt đầu một cuộc trò chuyện mới.

Ngoài ra, cần lưu ý rằng dù là Temporary Chat, OpenAI vẫn lưu bản sao trong tối đa 30 ngày để kiểm tra vi phạm chính sách an toàn. Điều này hoàn toàn hợp lý về mặt pháp lý, nhưng người dùng cần được hiểu rõ để tránh cảm giác “ẩn danh tuyệt đối”.

ChatGPT là một công cụ tuyệt vời và sẽ còn trở nên mạnh mẽ hơn nữa trong tương lai. Nhưng sự thông minh của AI không nên được đánh đổi bằng quyền riêng tư của người dùng. Người dùng cần thay đổi thói quen sử dụng AI một cách tỉnh táo hơn. Và song song đó, ChatGPT cũng cần thay đổi cách thiết kế để đặt quyền riêng tư ở vị trí trung tâm, chứ không phải ở cuối danh sách cài đặt.

Công Ty TNHH Phần Mềm SADESIGN

Mã số thuế: 0110083217